立即暂停训练更强大的AI!马斯克等超2300人签署联名信,科技大佬在担心什么;74页起诉书起底赵长鹏在美往事|一周国际财经(5)

2023-04-30 来源:飞速影视

Jie Wang表示,“我不担心AI模型能够像人类一样处理语言或像人类一样思考。相反,AI模型做这些事情是一件好事。但我们需要确保AI模型能够准确地完成这些事情。换句话说,我们需要让AI只做我们期望它们做的事情。” “我担心的是,AI模型可能会影响人们的思维方式并指导他们的行为方式。”他向记者解释,“假如真的有一天,人类由于受AI模型的影响,逐渐接受了AI模型给出的答案和表达方式是标准,那么人类的思想和行事方式就在不经意中被机器控制了。这封公开信的目的就是为了防止这个走向或其他目前还不知道的更危险的事情的发生。”

Jie Wang也描绘了一个更可怕的场景,如果开发或使用不当,与人类竞争的AI有可能超越人类。“当用户接受它的答案时,ChatGPT可能会在未来将其视为真理,渐渐地可能会建立自己的认知。如果通过基于ChatGPT构建的教育平台教导学生学习,那么他们可能会被训练成像 ChatGPT 一样思考。当这种情况发生时,我会认为ChatGPT已经超越了(学生的)思想。这很可怕。”

作为反对者,Dietterich的意见有一些相左。对于联名信中提出的4大风险, Dietterich认为只有“假新闻和宣传充斥信息渠道”是真实的。“毫无疑问,这些生成式AI工具将增加这种信息洪流,使用现有方法来过滤信息也变得更加困难。但这些工具也可能为我们提供改进的方法,因为新工具可以更好地理解信息。”

对于大众担心的工作被替代,Dietterich认为,一项新技术很少能使一项工作的所有方面都实现自动化,相反,它会使工作的某一部分得到简化和改进。至于AI超越人类、让人类失去对文明的掌控,Dietterich称其是“来自科幻小说”的无稽之谈:“(LLM)只有基本的推理能力,并输出许多错误和自相矛盾的陈述。计算机并不会与我们争夺食物、水或空气。”他认为,事实上新的AI技术正在提高我们记录文明并将传承给下一代的能力。

不过,Dietterich也承认,“每一个现存的金融骗局都是人类被愚弄的案例,新技术可能会加剧这个问题。但与此同时,新技术也可以帮助检测欺诈。”

共识:监管应用而不是监管技术本身

尽管科学界对于AI风险的定义不尽相同,但监管和控制是所有人共同的诉求。联名信要求,在这6个月内,所有AI实验室和独立学者都应该合力开发一套共享安全协议。协议完成后,应该由独立的外部专家进行严格的审计和监督。协议必须确保这些AI系统的安全。同时,开发者必须与政策制定者合作,加快开发强大的AI管理系统。

相关影视

在异世界获得超强能力的我,在现实世界照样无敌~等级提升改变人生命运~

2023/日本/日韩动漫

我到底在与什么作斗争

2021/日本/剧情片

3年A班:从现在起,大家都是人质

2019/日本/日本剧

关于完全听不懂老公在说什么的事

2014/日本/日韩动漫

刻在你心底的名字(2020)

2020/台湾/剧情片

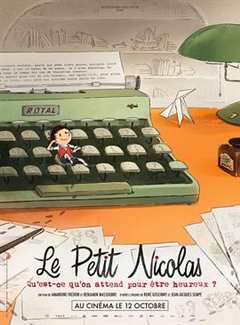

小淘气尼古拉 :我们还在等什么才能快乐?

2022/法国/动画片

关于完全听不懂老公在说什么的事第二季

2015/日本/日韩动漫

东北往事之痞子训练营

2016/大陆/剧情片

合作伙伴

本站仅为学习交流之用,所有视频和图片均来自互联网收集而来,版权归原创者所有,本网站只提供web页面服务,并不提供资源存储,也不参与录制、上传

若本站收录的节目无意侵犯了贵司版权,请发邮件(我们会在3个工作日内删除侵权内容,谢谢。)

若本站收录的节目无意侵犯了贵司版权,请发邮件(我们会在3个工作日内删除侵权内容,谢谢。)

www.fs94.org-飞速影视 粤ICP备74369512号