数字法治|潘芳芳:算法歧视的民事责任形态(3)

2023-05-01 来源:飞速影视

关于“敏感数据”的范围界定和类型划分,受不同国家、区域社会特定规范性文化的影响,在界定过程中存在很多差异。具体到算法歧视规制中的“敏感数据”的认定,除了反歧视法规范中所列示的性别、年龄、种族、国籍、残疾、心理的群体保护疾病或心灵能力、性取向、性别、性别认同、性别特征、宗教信仰、信条或个人政治意见等类型之外,针对具体化的算法决策适用场景可能会有所延伸和扩张。典型案例如“大数据杀熟”现象中,经营者根据顾客的经济能力和消费喜好而进行差异化定价。在该场景下,客观上与商品或者服务的价格设定没有关联性的当事人的经济能力和消费喜好,也可被视为与歧视相关的“敏感数据”。《个人信息保护法》中,将“敏感个人信息”界定为“一旦泄露或者非法使用,容易导致自然人的人格尊严受到侵害或者人身、财产安全受到危害的个人信息”,并且在“人格尊严”与“人身、财产安全”的双重保护目标与功能下,立法者将“生物识别、宗教信仰、特定身份、医疗健康、金融账户、行踪轨迹等”以列举的形式,明确纳入个人敏感信息的范畴。保护当事人免受歧视性待遇是保护当事人“人格尊严”的重要内容。是故,但凡非交往或者交易中所必需,但一旦在决策程序中使用就会招致歧视性待遇和后果的信息,均可经扩张解释,纳入法条中具有兜底性质的“等”字范畴之内。

由此,行为人如若在算法程序运行中使用了歧视性“敏感数据”或可能造成歧视性后果的数据,便可推定其主观上故意实施了算法歧视的侵权行为。除非行为人能够对所使用“敏感数据”与最终决策之间合理、正当的关联性和数据使用的必然性进行解释和说明,并能够证明自身已经采取适当的措施,避免因敏感数据使用而带来的歧视性后果。否则,在被决策者权益因算法歧视行为而遭受侵害时,行为人要为之承担相应的侵权责任。

2.过失违反作为义务

侵权法最能够反映特定社会和文化背景下社会关系、经济关系和伦理道德观念。侵权责任机制中,司法者可通过行为人所负担的“作为义务”内容的适度扩张和解释适用,将特定社会背景下人们的现实需求、特定的道德伦理观念、社会交往方式和交易习惯融入侵权责任规制机制中,弥补“规范滞后”的不足。按照德国判例与学说中的观点,“作为义务”的产生,源于法律规定、合同约定和先前危险行为;“作为义务”内容的扩张理由,则包括“风险社会”下危险控制的需要、法律理念由个人本位转向社会本位的必然要求和“道德法律化”理论的要求三种。其中,作为“作为义务”产生依据之一的“法律规定”,不仅指代民事基本法,还包括国家因保护特殊主体或者权益而制定和实施的、带有公法性质的特别法规范。在算法歧视的私法救济和民事责任规制路径建构中,可由主体的“作为义务”(内容的扩张)发挥“导管”作用,将特别法规范中倡导和设定的价值理念、原则、规则和制度等引入私法救济体系中,通过私主体间权利义务关系的构建,来实现国家干预和调控的目的,维护和保障社会利益和公共秩序。

相关影视

芳芳郁金香

2003/法国/喜剧片

小芳的故事

1994/大陆/剧情片

正义的算法

2022/台湾/台湾剧

负有责任的孩子

2019/英国/剧情片

举证责任

2023/美国/记录片

法治中国

2017/大陆/记录片

治外法权

2015/韩国/动作片

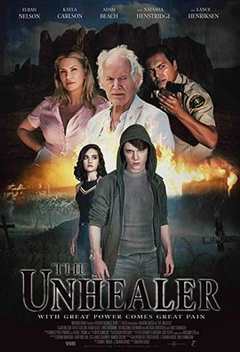

无法治愈

2020/美国/科幻片

合作伙伴

本站仅为学习交流之用,所有视频和图片均来自互联网收集而来,版权归原创者所有,本网站只提供web页面服务,并不提供资源存储,也不参与录制、上传

若本站收录的节目无意侵犯了贵司版权,请发邮件(我们会在3个工作日内删除侵权内容,谢谢。)

若本站收录的节目无意侵犯了贵司版权,请发邮件(我们会在3个工作日内删除侵权内容,谢谢。)

www.fs94.org-飞速影视 粤ICP备74369512号